Un marco de políticas propuesto para los medios sintéticos

Ninguno de los daños causados (o posibles) a través de los medios sintéticos es exclusivo de los métodos de producción de dichos medios, y ninguno de ellos puede prevenirse estrictamente mediante el control de la tecnología de su producción. Por lo tanto, un marco de políticas para abordar los riesgos de los medios sintéticos dañinos debe ser un marco de políticas para los medios digitales en su conjunto. Si bien hemos observado varias propuestas de políticas en las últimas semanas, la mayoría han tenido un enfoque limitado, con posibles consecuencias no deseadas de gran alcance. Este borrador tiene como objetivo destacar algunas piezas faltantes y generar una mayor conversación.

El señor Smith va a Washington

El señor Smith va a Washington

La audiencia de esta propuesta

Los daños de los medios sintéticos son globales tanto en su origen como en su objetivo, y las apuestas no podrían ser más altas. Pero el panorama legislativo, así como el panorama de la opinión pública, dista mucho de ser uniforme. Nos hemos esforzado por concebir una política que pueda adaptarse y ser adoptada por los gobiernos nacionales y regionales de América del Norte, Europa e India, como mínimo. (Muchos de esos gobiernos están aprobando regulaciones pertinentes en este momento.)

Objetivos de este marco

Los objetivos de este marco no son eliminar la creación de deepfakes (ni ninguna otra forma de medios sintéticos). Son:

Reducir el alcance de los daños, y…

Hacer explícita la autoría, lo que nos permite…

Trasladar los daños subyacentes a la jurisdicción de las regulaciones existentes…

…y lograr todo lo anterior con la máxima RAPIDEZ.

Para ser precisos, existen daños reales tanto al suprimir medios sospechosos de ser sintéticos cuando no lo son, como al permitir que los medios sintéticos se hagan pasar por reales. Esta propuesta se esfuerza, no solo por equilibrar esos daños, sino por diferir el juicio final sobre dicho equilibrio a la función judicial en la jurisdicción correspondiente, tan rápidamente como sea posible.

Además, es nuestro objetivo no proponer ninguna política que desafíe o modifique la regulación actual en torno a la libertad de expresión, la expresión política o la interferencia extranjera.

¿Qué medios quedarían cubiertos bajo esta política?

Si bien es concebible que los medios sintéticos se utilicen para todos los fines posibles (buenos y malos), los daños específicos que ya se han observado son los siguientes:

Interferencia política interna Robo de identidad y fraude Pornografía no consensual Interferencia política extranjera Campañas militares de desinformación Fraude de seguros Pruebas falsas

Cualquier medio (fotografías, videos, grabaciones de audio, ya sea difundido públicamente o distribuido de forma privada) que intente o logre estos daños, está dentro del alcance de esta política.

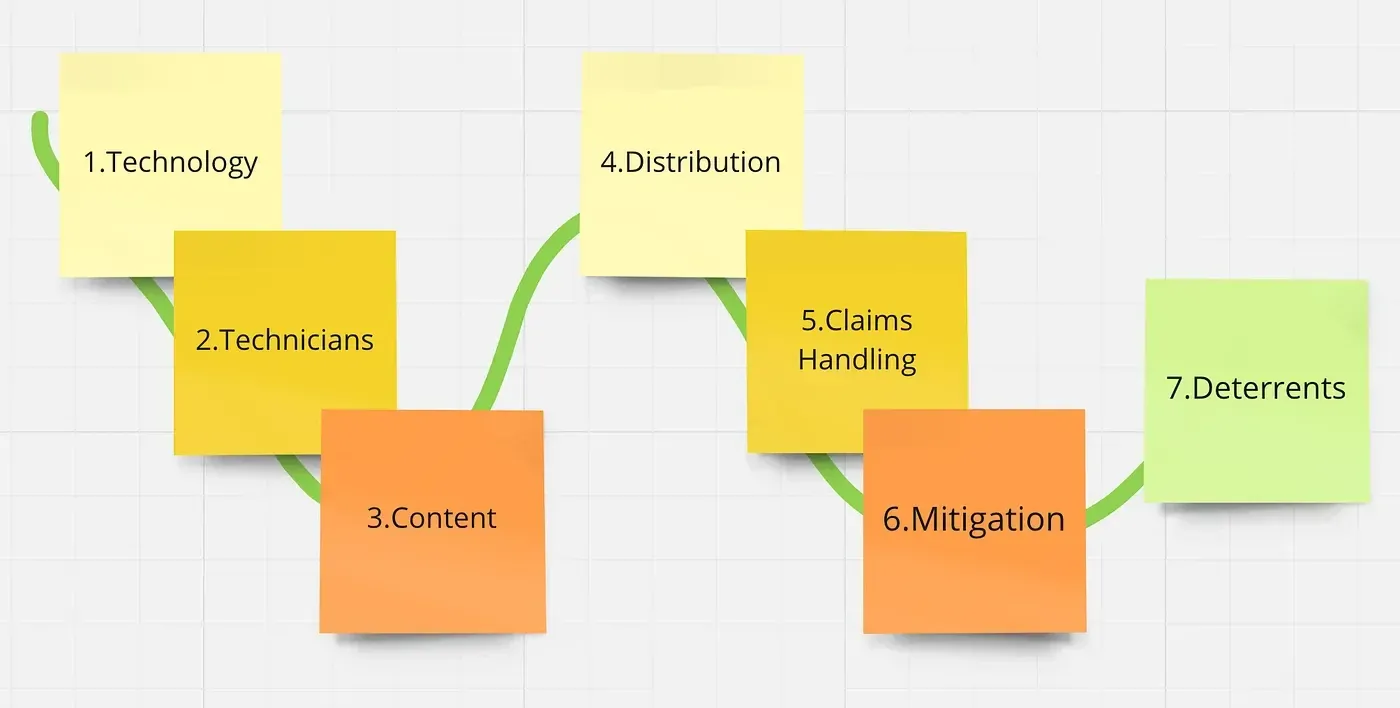

Marco para la política de medios

Este marco debe estructurarse en torno al ciclo de vida completo de los medios, desde la captura o creación hasta la publicación, los informes y la mitigación, y abordar a los diversos actores involucrados.

Un marco para la política de medios

Un marco para la política de medios

1. Tecnología de creación de medios sintéticos

Podríamos intentar regular el uso de enfoques "fuertes" de deepfake de la misma manera que regulamos el cifrado fuerte (como munición, bajo el ITAR); sin embargo, probablemente es demasiado poco y demasiado tarde para este enfoque. Las tecnologías de deepfake actuales ya son el AR-15 de la generación de medios sintéticos, y no existe ninguna "línea" tecnológica natural (resolución, velocidad de fotogramas, cantidad de potencia informática por píxel o fotograma, complejidad del conjunto de datos de entrenamiento, etc.) que no haya sido ya cruzada…

… el gato ya está fuera de la bolsa.

En cambio, debemos establecer estándares para la procedencia de los medios, y exigir que los medios que causen daño defiendan su procedencia. Esto refleja la política que se ha aplicado a las cuestiones de derechos de autor bajo el DMCA/ISD — una vez que se realiza una reclamación de infracción de derechos de autor, el editor del medio está obligado a proporcionar evidencia de su derecho a usar el medio en cuestión. Cuando lo haya hecho, la carga de la prueba recae sobre el reclamante para desacreditar esos derechos.

La procedencia mínima para los medios debe establecer cuándo, dónde y con qué dispositivo se capturó el medio fuente original. Los medios construidos que no son una edición de algún medio fuente original no requieren procedencia, pero no deben afirmar ser otra cosa que sintéticos.

(Reconocemos que las herramientas para la captura y autenticación de la procedencia de los medios aún no están ampliamente disponibles; a corto plazo, la forma más simple de procedencia es una declaración jurada del productor del medio.)

2. Deberes de los técnicos

Si bien una de las mayores amenazas del panorama mediático actual es la creciente facilidad con la que los aficionados, con presupuestos reducidos y herramientas de código abierto o de libre disponibilidad, pueden producir medios sintéticos convincentes y confusos, crear deepfakes verdaderamente indetectables es (y probablemente seguirá siendo) el dominio de los expertos, al menos por ahora.

Obviamente, los criminales y los agentes extranjeros no tienen interés ni obligación respecto a licencias o certificaciones. Pero cabría esperar que la mayoría de los profesionales que desarrollan deepfakes para fines legítimos (películas, publicidad, comedia) suscribieran un estándar de conducta empresarial, vinculado a un órgano de supervisión. (Esto sería similar a cómo se gobierna a los artesanos, médicos, cabilderos, contadores y otros profesionales.) Cualquier participación en medios dañinos pondría en riesgo su capacidad de participar en medios sintéticos lícitos y lucrativos.

Hasta ahora no ha habido ningún intento exitoso de crear un organismo supervisor para los profesionales del software; si se intenta un esquema de licencias o certificaciones en el contexto de la inteligencia artificial, tendría sentido incluir la síntesis de medios en su alcance. Las certificaciones requeridas deben estar alineadas con el tamaño y el alcance de la empresa involucrada, similar a la diferencia entre un "handyman" y un carpintero con certificación Red Seal.

3. Políticas de contenido

Tenemos una única recomendación de política básica a nivel de contenido: Cualquier medio que genere una representación sintética de una persona real o un evento contemporáneo debe estar etiquetado como sintético.

Establecer dicha política de etiquetado (y trabajar estrechamente con las principales plataformas de distribución en la experiencia del usuario de dicho etiquetado) evitará la mayor parte del posible exceso de alcance de este marco de políticas, y preservará los derechos a usar medios sintéticos de todas las formas para sátira y comentario político. La DEEPFAKES Accountability Act es un punto de partida razonable para dicho etiquetado, y podría ampliarse con mayor profundidad en el almacenamiento y verificación de metadatos.

Creemos que dicho etiquetado debe estar dentro del propio medio, y no solo dentro de la plataforma de distribución. Esto ayudará a abordar el panorama regulatorio desigual de la distribución (lo que hemos llamado el Desafío TikTok), así como el papel principal que los grupos de comunicación privados con jardines amurallados juegan ahora en la circulación de desinformación (la Brecha de WhatsApp).

Por supuesto, muchos de los daños de dicho contenido no se mitigan simplemente con etiquetarlo — pero creemos que todos esos otros daños tienen regulaciones existentes que los abordan. Más allá del etiquetado, lo que se requiere es un mecanismo expedito de baja fricción para habilitar y apoyar esos esfuerzos de aplicación de la ley existentes. Esto podría incluir actualizaciones a la Sección 230 que aplicarían un "deber de cuidado" para el contenido ilícito, como se ha sugerido en el testimonio ante el Congreso.

La segunda categoría de medios dañinos es la de los medios que han sido editados sustancialmente, de modo que el significado y el contenido del medio original se altera u oscurece. Sin embargo, la mayoría de los medios se editan antes de su publicación. Para tratar el contenido de los medios "trivialmente editados" como equivalente al de la fuente original, debemos acordar la definición de "editado sustancialmente", que podría incluir cambios en la velocidad de fotogramas, oscurecer o insertar contexto, o eliminar selectivamente fotogramas de video o audio. Los medios editados sustancialmente deben tener los mismos requisitos de etiquetado que los medios sintéticos.

4. Distribución de medios sintéticos

Es probable que sea imposible para cualquier plataforma importante de distribución de medios implementar un proceso de revisión de contenido objetivo y no partidista. (Ciertamente es poco probable que ocurra bajo una autogobernanza voluntaria.) Incluso si fuera posible, será imposible auditarlo o confirmarlo externamente y, por lo tanto, imposible de confiar.

Afortunadamente, la revisión de contenido no es necesaria. (Como dijo famosamente Linus Torvalds, "Con suficientes ojos, todos los errores son superficiales.") Lo que sí se requiere es una sólida obligación de participar en programas extendidos de informes y mitigación (como la Ley de Servicios Digitales del Reino Unido existente, etc.). Estos programas de mitigación requerirán que las plataformas apoyen la verificación de los estándares emergentes de procedencia de medios y de la identidad del editor (ya una característica común).

Las políticas específicas para informes y mitigación deben incluir plazos en horas o días, no semanas o meses.

5. Manejo de reclamaciones de daño

Al igual que el proceso DCMA, las solicitudes de mitigación de medios dañinos deben ser presentadas por aquellos con "legitimación procesal". Esto es, más simplemente, el individuo o un miembro del grupo perjudicado, o un representante legal. Fuera de los daños donde una agencia gubernamental existente está activamente involucrada (como la interferencia electoral o las campañas de desinformación extranjera), es probable que sea inapropiado que el gobierno desempeñe un papel importante en el monitoreo e informe de contenido.

Cuando se presenta una reclamación de daño (ya sea ante las autoridades o directamente a una plataforma de distribución de medios), el receptor de la reclamación debe contactar al editor del medio con una "demanda de procedencia". Dependiendo de la gravedad de los daños reclamados, el umbral para establecer la procedencia podría variar desde una declaración jurada del editor hasta metadatos autenticados o cadena de custodia. Es importante que el umbral se base únicamente en las apuestas de la reclamación, no en las del reclamante o el editor.

Mientras el editor del medio pueda proporcionar la procedencia que cumpla con este umbral inicial, su medio permanece disponible y sin modificaciones; la carga de la prueba recae ahora sobre el reclamante para demostrar que su procedencia es falsa o insuficiente (y el umbral para demostrar una procedencia falsa debe ser mucho más alto que el presentado al editor). Si ocurre que el reclamante puede cumplir con dicho umbral (o si el editor del medio no logra proporcionar procedencia en primer lugar), el medio dañino debe ser mitigado por la plataforma.

Los plazos para la notificación y respuesta deben ser proporcionales a la velocidad a la que se está viendo el medio; en casos donde los medios sintéticos dañinos son tendencia en las plataformas de redes sociales y son vistos por millones de personas por hora, la procedencia debe demostrarse o afirmarse en cuestión de horas. Y en casos donde las reclamaciones de daño son extremadamente probables (como anuncios políticos, medios que muestran a personas famosas, figuras políticas, eventos bélicos o pornografía), la plataforma podría optar por exigir procedencia para la publicación inicial de medios.

Las plataformas de medios deben mantener recursos disponibles para abordar y manejar las reclamaciones en proporción a la tasa de reclamaciones dentro de esa región, tema o comunidad.

6. Mitigación de medios dañinos

Como se ha documentado ampliamente en otros lugares, la eliminación de medios falsos suele ser el enfoque equivocado. En el caso del acceso público a contenido editado como un deepfake, las plataformas tienen la obligación de redirigir a los espectadores al contenido original sin editar, describiendo pero no mostrando las ediciones dañinas. Los medios sintéticos destinados a la crítica o la sátira deben tener la opción de aplicar el etiquetado apropiado como solución simple.

En el caso de medios dañinos que fueron construidos completamente sin una fuente original, donde el editor no está dispuesto a cumplir con el etiquetado o donde los medios son ilegales independientemente del etiquetado, los medios deben ser reemplazados con un medio alternativo proporcionado por el reclamante.

La mitigación debe enfatizar la redirección, no la eliminación

La mitigación debe enfatizar la redirección, no la eliminación

Las plataformas de medios a menudo tienen métodos para notificar a los espectadores sobre contenido nuevo o actualizado; deben usar estos métodos para notificar a los espectadores que estuvieron expuestos al medio dañino original sobre su naturaleza sintética, y proporcionar acceso al contenido redirigido o de reemplazo si corresponde. De manera similar, las plataformas de comunicación privada como WhatsApp, Instagram Group Chats, etc., deben enviar un mensaje adicional a los miembros del grupo de chat (o miembros anteriores) con la notificación.

Debemos tratar cualquier mitigación de medios dañinos esencialmente como la aplicación de una orden judicial, con la misma responsabilidad de evitar emitir juicios sobre el autor o editor antes de que se tome una determinación final.

Los medios, especialmente los medios sensacionalistas, se propagan rápidamente. Esta propagación ocurre en muchas plataformas, con clips de videos populares copiados de YouTube a Instagram, a TikTok, a Facebook. Las plataformas de medios tienen la obligación de coordinar los esfuerzos de mitigación, de modo que los reclamantes no carguen con la responsabilidad de perseguir medios dañinos en decenas de plataformas. Puede ser necesario realizar enmiendas regulatorias para simplificar dicha coordinación.

7. Elementos disuasorios

Los daños más graves que estamos discutiendo (interferencia extranjera en elecciones, difamación, pornografía no consensual, fraude) son todos delitos graves por sí mismos; los elementos disuasorios adicionales para el uso de deepfakes en la comisión de estos delitos probablemente serían irrelevantes. Lo que queda, por lo tanto, es la complicada cuestión del "comentario político sin etiquetar", o las campañas de desinformación que se hacen pasar por sátira. Hacer a los técnicos, consultores y creativos de medios conjuntamente responsables del uso indebido de las tecnologías de síntesis es probablemente el elemento disuasorio más eficaz. Las sanciones para los reincidentes deben amplificarse.

Conclusiones

Si bien las amenazas que plantean los deepfakes pueden sentirse nuevas y emergentes, el problema subyacente de los medios sintéticos se ha acelerado durante décadas. Un intento de abordar los daños de dichos medios está muy atrasado. Este marco es un borrador, destinado a abordar algunas brechas y estimular una mayor discusión.

¿Quiere ver Polyguard en acción?

Experimente la verificación de identidad en tiempo real para la seguridad de sus comunicaciones.